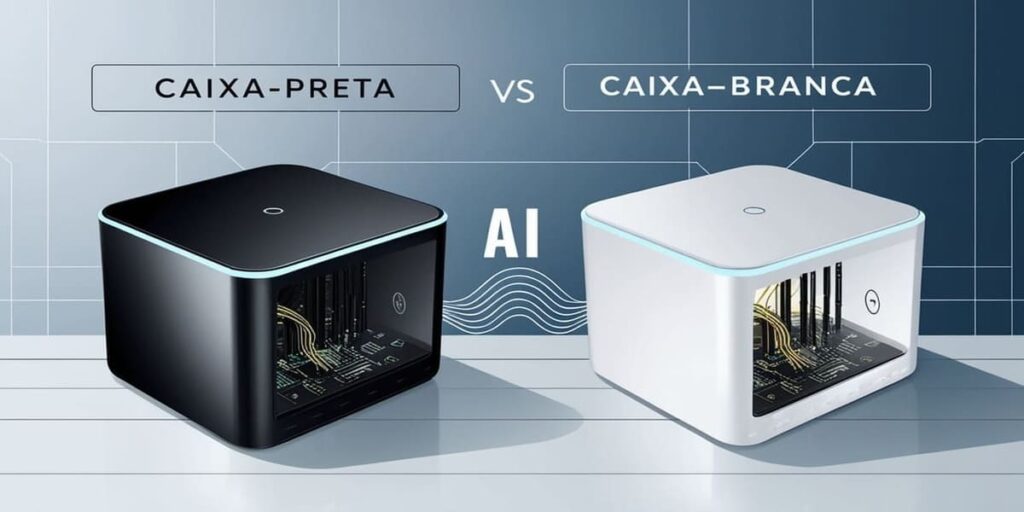

O dilema central da era da Inteligência Artificial (IA), todos os dias, algoritmos guiam escolhas com uma eficiência que, à primeira vista, parece inquestionável. Contudo, essa mesma eficiência esconde seus passos em um labirinto de códigos e dados, em um lugar que a ciência e a sociedade convencionaram chamar de “caixa-preta da IA”. Este enigma nos confronta com uma pergunta inquietante que transcende o campo da tecnologia: até que ponto podemos seguir uma inovação que se recusa a explicar seus próprios caminhos?

A IA já transformou o mundo de maneira irreversível, desde a forma como nos deslocamos nas cidades até as narrativas de entretenimento que consumimos. No entanto, a opacidade de seus modelos levanta debates éticos e sociais que ultrapassam os limites dos laboratórios de pesquisa. É neste cenário de incerteza que surge a proposta da “caixa-branca”: algoritmos que se apresentam como um livro aberto, oferecendo a clareza e a transparência necessárias para restaurar a confiança. Essa busca por explicações acende uma esperança fundamental para o futuro da interação humana com a tecnologia.

O que é Caixa-preta da IA?

É como um oráculo moderno, você faz uma pergunta, recebe uma resposta, mas o raciocínio por trás dela permanece envolto em névoa. Sistemas como redes neurais profundas, com seus milhões de cálculos entrelaçados, processam dados com uma precisão impressionante, mas escondem o “como” de suas escolhas. Para quem usa ou depende desses sistemas, é como confiar em um mapa sem ver as estradas que ele traça.

Essa opacidade não é um defeito, mas uma consequência da complexidade. Cada camada de uma rede neural ajusta pesos e conexões, aprendendo padrões que nem sempre traduzimos em palavras. O preço dessa eficiência é a dificuldade de explicar decisões, o que gera dúvidas sobre até que ponto podemos confiar no que não entendemos.

Pense em um algoritmo que não guarda segredos, como um caderno de anotações onde cada passo está claro para quem quiser ler. A caixa-branca é essa promessa de transparência, onde cada decisão pode ser rastreada, desde os dados que entram até a lógica que leva a uma resposta. É um convite a enxergar a mente da máquina, com clareza que acalma quem teme o desconhecido.

Essa abertura traz confiança, especialmente em áreas onde erros custam caro, como hospitais ou tribunais. Um sistema que explica por que escolheu um tratamento ou uma sentença permite corrigir falhas e aprender com elas, construindo pontes entre a tecnologia e as pessoas que ela serve.

A caixa-preta é um prodígio de precisão, capaz de encontrar padrões em oceanos de dados com uma rapidez que humanos jamais alcançariam. Mas sua força vem com um custo: suas decisões são como quadros pintados sem revelar os pincéis usados. Isso a torna ideal para tarefas complexas, como reconhecer rostos ou prever o clima, mas arriscada onde a confiança exige explicações.

A caixa-branca, por outro lado, é como um professor paciente, mostrando cada etapa de seu raciocínio. Ela sacrifica um pouco da potência para ser compreensível, o que a faz brilhar em contextos que pedem auditoria, mas pode limitar sua habilidade em lidar com problemas mais intricados. O desafio é encontrar um meio-termo, onde precisão e clareza caminhem juntas.

Perigos da Caixa-preta

Quando uma IA decide alguma coisa sem explicar, o risco vai além de um simples erro. Em um hospital, um diagnóstico errado pode mudar uma vida; em um banco, a recusa de um crédito sem motivo claro pode alimentar injustiças. A opacidade da caixa-preta torna difícil apontar onde algo falhou, como tentar consertar um relógio sem ver suas engrenagens.

Essa falta de clareza também abre portas para vieses escondidos. Se um algoritmo aprende com dados cheios de preconceitos, ele pode perpetuá-los sem que ninguém perceba, como uma sombra que cresce sem ser notada. Em áreas sensíveis, essa incerteza erode a confiança, deixando perguntas sem resposta e responsabilidades no ar.

Há esperança em sistemas que misturam o melhor dos dois mundos. Modelos híbridos usam a força das caixas-pretas para resolver problemas complexos, mas adicionam camadas de explicação que iluminam o caminho das decisões. É como um chef que não só serve o prato, mas compartilha o segredo de seu tempero, equilibrando sabor e confiança.

IA Explicável (XAI)

A IA explicável, ou XAI, é um passo nessa direção, como uma lanterna que clareia os cantos escuros da caixa-preta. Ela não abre tudo, mas oferece pistas sobre por que um sistema escolheu certo caminho, ajudando médicos, juízes ou qualquer um a entender o suficiente para confiar. Essa ponte entre o técnico e o humano é essencial para tornar a IA uma aliada, não um mistério.

Outra solução é chamar os detetives da tecnologia: auditores independentes que examinam algoritmos como quem lê um diário, procurando falhas ou intenções escondidas. Essas revisões garantem que a IA jogue limpo, dando a certeza de que suas escolhas são justas e podem ser questionadas quando necessário.

O Papel da Regulação

As leis também têm voz nesse debate. Regras claras podem obrigar empresas a revelar mais sobre seus algoritmos, como um contrato que exige honestidade. Na Europa, o AI Act está tomando forma, com promessas de exigir transparência em áreas onde a IA toca vidas, saúde, finanças, justiça. É um sinal de que o futuro pode ser tecnológico, mas não às custas da confiança.

Regulações como essas não são só burocracia; elas protegem o que nos torna humanos, garantindo que máquinas sirvam às pessoas, e não o contrário. Com normas bem desenhadas, a IA pode crescer sem deixar sombras que nos assombrem.

No coração da IA, há uma escolha difícil: abraçar a precisão das caixas-pretas, que resolvem enigmas com uma eficiência quase sobrenatural, ou optar pela clareza das caixas-brancas, que explicam tudo, mas nem sempre alcançam o mesmo brilho. É como decidir entre um carro veloz sem manual e um mapa detalhado que exige paciência. Encontrar o equilíbrio é o grande desafio dos que moldam o futuro.

Esse dilema não é só técnico, é humano. Quanto estamos dispostos a sacrificar por respostas perfeitas, e quanto precisamos saber para confiar? A resposta está em construir sistemas que não nos peçam para escolher entre os dois.

Considerações Finais

A dança entre a caixa-preta e a caixa-branca da IA é mais do que um debate técnico, é uma reflexão sobre o que esperamos da tecnologia. As caixas-pretas nos encantam com sua potência, mas nos desafiam com seus segredos; as caixas-brancas nos acolhem com sua abertura, mas pedem paciência para brilhar. O caminho à frente parece claro, combinar a força de uma com a alma da outra, guiados por regras e auditorias que mantenham a confiança em pé. Porque, no fim, a IA não é só sobre máquinas, é sobre nós, e o mundo que queremos construir juntos.

FAQ: Caixa-preta da IA

-

O que é a Caixa-preta da IA?

A caixa-preta da IA refere-se à falta de clareza sobre como os sistemas de IA tomam decisões, tornando difícil entender o processo interno.

-

O que é a Caixa-branca da IA?

A caixa-branca da IA descreve sistemas que são completamente transparentes e cujos processos de decisão podem ser compreendidos e auditados por humanos.

-

Qual é o Maior Problema da Caixa-preta?

O maior problema da caixa-preta é a falta de transparência, que impede a identificação de erros e a atribuição de responsabilidades.

-

Como a Caixa-branca Difere da Caixa-preta?

Enquanto a caixa-preta é opaca e difícil de entender, a caixa-branca é transparente e explicável, facilitando o rastreamento do processo decisório.

-

Como a IA Explicável Pode Ajudar?

A IA explicável (XAI) visa abrir a caixa-preta, tornando o processo de decisão mais claro sem comprometer significativamente a precisão do sistema.